你不是在搞理論演練,而是每天面對幾十萬人同時登陸、刷新頁面、提交請求,還得讓系統快得像開了掛,別說卡頓,連掉線都算大事故。別信什麼「買個貴的雲服務就穩了」——那只是安慰劑。真正扛得住壓力的,是底層設計能不能經得起真實場景的暴打。

市面上那些看起來「穩如老狗」的SaaS,背後其實都踩過坑,甚至有人為此半夜爬起來修系統。這5個關鍵點,幾乎每一個都曾讓人頭大到想砸電腦。現在不講教科書,也不列條列項,就掰開揉碎跟你聊聊:怎麼避開90%的坑,少走冤枉路。

1. 資料庫分片到底怎麼切?先問自己:資料該按什麼分?

別一上來就覺得「按公司分」或「按地區分」很合理。聽我一句:這種做法表面看挺順,實際上就是埋雷。你永遠不知道哪天會突然冒出個城市爆發活動,結果那一台機器直接被壓垮,其他節點卻閒著。

最穩的還是按用戶ID取模,比如 user_id % 8,分到第0到第7個庫。簡單、可預測,適合起步擴展。每個分片獨立跑,單個掛了也不會拖垮全系統。中間件像TiDB、MyCat能自動路由,但別太依賴它——尤其跨分片查資料時,性能直接跳水。

重點提醒:

分片數不是越多越好,3~8個剛剛好,再多反而維護複雜,跨分片查詢根本跑不動。

別用「租戶」當分片鍵,尤其是要做多租戶的場景。日後遷移數據、同步權限會把你逼瘋。

最容易忽略的盲點:分片後沒定期檢查各庫數據量差異。有次我們以為分片搞定一切,結果半夜警報響起——因為某個分片索引沒重建,查詢全走全表掃描,整個系統卡成靜音模式,四小時才恢復。

真事分享:建議分片後加個自動巡檢腳本,定期看各分片大小,發現偏差太大馬上告警。不然等崩了再找,已經晚了。

2. 伺服器擴容不能只靠加機器,無狀態 自動化才是真本事

很多人誤以為:買台頂級伺服器,就能撐住流量。結果一次大促,資源打滿,系統直接癱瘓。這不是技術問題,是思維錯了。

正確做法是:所有應用必須「無狀態」——別存登入資訊、別存臨時文件、別靠本地磁碟。用 Docker Kubernetes 容器化部署,服務能快速複製、自動排程。負載均衡器(比如 Nginx、AWS ALB)要設健康檢查,節點出問題立刻剔除。

監控 CPU/記憶體,超過70%觸發自動擴容,但!不能盲目加機器。我見過團隊加機器加到100台,結果資料庫連接池被佔滿,直接雪崩。更糟的是,新機器配置不一致,一上線反而連不上,負載越堆越高。

容器化雖好,但鏡像版本管理要是亂來,更新一次就可能「昨天還好好的,今天全崩了」。最常見的死法就是:擴容沒設上限,流量突增一路加,錢燒得飛快,系統還沒救回來。

真實案例:某電商雙十一前做擴容測試,發現每新增一台機器,資料庫連接數就飆升。原來沒限制「每節點最大連接數」,導致連接雪崩。後來才明白:擴容前一定要先壓力測試,確認資料庫、磁碟、網絡都跟得上。

3. 快取不是加個 Redis 就完事,關鍵在「怎麼用」和「別亂用」

很多人一開始就把所有資料塞進 Redis,結果命中率低得離譜,資料庫壓力反而更大。這不是優化,是添亂。

真正有效的做法是:只快取「熱點資料」——用戶頭像、商品列表、公開配置這些。快取時間至少10分鐘起,太短沒意義,太長又顯示舊資料。

記得加「快取穿透」防護:查不到資料,也把空結果存進去,避免重複查詢資料庫。還可以用布隆過濾器(Bloom Filter)提前篩掉不存在的請求,省下不少無謂探詢。

但最致命的陷阱是:如果快取的是「會變的資料」,比如購物車數量,又沒設合理失效機制,就會出現「明明已下單,系統卻顯示還未加入」這種翻車現場。

多機器環境下,快取分散在不同節點,沒用一致性哈希的話,很可能出現「這台機器清了快取,那台還在用」的錯亂。而且,別統一設30分鐘過期——有些資料幾分鐘就變,有些能用半天,得根據業務分級。

血淚經驗:某金融系統把交易明細快取30分鐘,結果用戶查不到最新記錄,客服一天接到上百通投訴。後來改成「事件驅動 主動失效」,每次交易完成就立刻清除快取,問題才解決。

➤ 建議:快取策略要有「業務語義」,不能光看技術參數。別拿參數騙自己。

4. 故障處理別等修復,自動降級 熔斷才是救命稻草

資料庫慢成狗,系統還硬撐著等,結果所有功能都卡住,用戶體驗直接崩潰。這種情況,靠人工修復已經來不及。

要用 Sentinel、Hystrix 之類工具設熔斷規則:失敗率超過50%,馬上關閉該功能。降級方案要明確——推薦算法停用,就顯示「暫時關閉」;購物車無法即時更新,允許繼續下單,後續補同步。

非核心功能優先降級,保障主流程(登入、支付、訂單提交)不中斷。但注意:別把「熔斷」當萬靈丹。有些人一出問題就全部關掉,用戶完全不知道發生了什麼,反而嚇跑人。

最危險的誤區是:認為「用了熔斷就不怕故障」。錯了,熔斷只是減輕傷害,不能阻止故障發生。而且,熔斷後沒恢復機制,系統可能一直處於降級狀態,直到人工手動恢復。

實戰案例:某社交平台大促期間快取失效,資料庫被打爆,系統自動熔斷。結果所有內容顯示「系統繁忙」,用戶以為平台崩了,大量轉向競爭對手。後來才學乖:熔斷後要給用戶清晰提示,並在後台持續監控恢復狀態,必要時自動嘗試恢復。

5. 監控與告警別堆工具,得能「看得懂、救得快」

監控項目至少要包含:伺服器負載、資料庫連接數、API響應時間、錯誤率、慢查詢數。告警方式得多通道:手機短信 WhatsApp群組 電子郵件,確保有人看到。

用 Prometheus Grafana 做視覺化,但別以為「畫出來」就代表有用。很多人只盯「平均響應時間」,卻忽略了「95%分位數」——一個接口平均0.5秒,但10%請求要3秒,用戶一樣覺得慢。

告警太多變成「狼來了」,最後大家都不理。必須設「去重」和「沉默期」。最常見的錯誤是:只監控前端,忘了後端服務之間的調用鏈。一旦某個微服務掛了,前面的系統還在正常運行,根本看不出問題。

真實經歷:某平台連續三天收到「伺服器負載高」告警,結果排查發現是某內部服務在循環調用,資源耗盡。但因為沒追蹤調用鏈,花了整整一天才定位。

➤ 建議:一定要接入 OpenTelemetry 之類工具,把跨服務的調用關係畫出來。不然就像在黑箱裡修車,瞎摸。

什麼情況下別碰這套方案?——強烈勸退指南

以下情況,真的建議放棄自建千萬級系統,直接選成熟SaaS:

你只有百人規模,每月收入不到50萬,還想追求「萬人級穩定」——純屬浪費錢,不如把錢花在市場上。

沒有專職後端工程師,靠外包或兼職開發——系統一上線就出問題,維護成本遠超收益,遲早崩盤。

你的業務變化快,需求頻繁調整,又不想花時間重構架構——自建系統根本跟不上節奏。

預算低於10萬/年,還想實現「零宕機」——現實是,雲服務 人力投入至少20萬起步,別天真了。

結論:如果你屬於以上任一情況,別硬撐。直接選成熟的SaaS平台(如 Zoho、Salesforce、Shopify),省心、省力,還能快速迭代。

行業內真正的主流做法(平替方案)

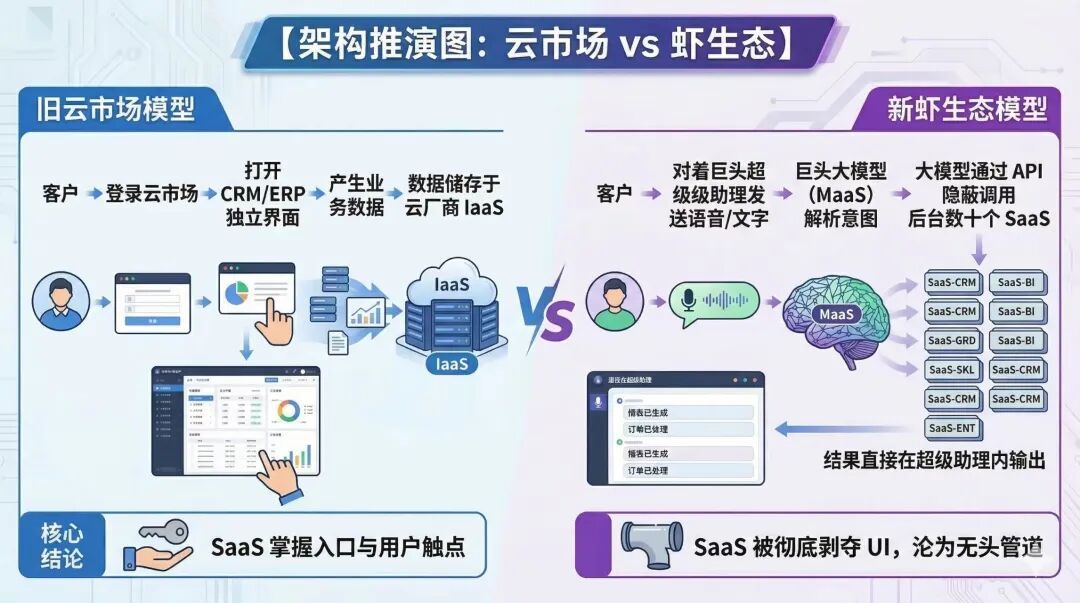

別被「自建」迷住眼。現在大部分企業其實都在用「混合策略」:

核心功能用SaaS:客戶管理、訂單系統、財務模塊,直接用 Zoho、HubSpot,不用自己開發。

非核心模塊自建:比如內部審批流程、特定報表生成,用現成框架(如 Node.js Express PostgreSQL)快速搭起來。

關鍵環節用雲原生工具:資料庫用 AWS RDS Aurora,快取用 Cloudflare Redis,監控用 Datadog,不自己搭全套。

小團隊可用「托管方案」:比如 Vercel Supabase,一套工具搞定前端 後端 資料庫,成本低、上手快。

平替思路:不是所有東西都要自己造輪子。用好現成工具,把精力集中在「業務價值」上,才是正道。

最後一句大白話

系統能不能撐住千萬用戶,不在於你用了多「高科技」的技術,而在於你能不能早一點發現問題、快一點修復、不瞎搞擴容、不迷信自建。

別聽誰說「我們架構很牛」,去看他過去半年有沒有崩過。

真的能扛住壓力的系統,都是在一次次崩潰後,一點點磨出來的。

(順便說一句:我見過太多團隊,嘴上說要自建,結果第一年就換了三波工程師……)